En annonçant cette extension de partenariat, AWS montre un intérêt renouvelé pour l’IA générative, un domaine dans lequel il est présent à travers des services et des technologies propriétaires. Cependant, la donne a changé et le marché a été boosté par la sortie de ChatGPT et la compétition entre Microsoft et Google. Un domaine qui devrait vite prendre son essor commercial, tiré par les cas d’application comme la création de contenus. Car, l’IA générative peut être utilisée pour créer du contenu dans une variété de formats, notamment du texte, des images et des vidéos.

Généraliser l’usage de son écosystème d'IA générative

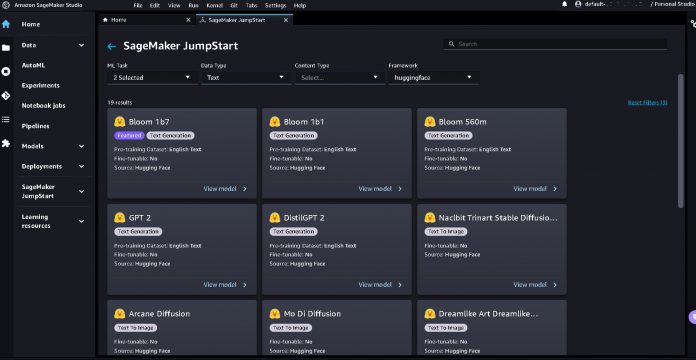

AWS entend mettre à profit son écosystème en matière d'IA générative. Celle-ci va de l’IA conversationnelle grand public d’Alexa qui interagit avec les clients des milliards de fois chaque semaine, et utilise de plus en plus l'IA générative dans le cadre de nouvelles expériences comme Créer avec Alexa, à des outils et services, y compris l'infrastructure, sur Amazon SageMaker et les services d'IA, comme Amazon CodeWhisperer, un service qui améliore la productivité des développeurs en générant des recommandations de code basées sur le code et les commentaires dans un IDE. AWS a également créé des accélérateurs ML spécialement conçus pour la formation (AWS Trainium) et l'inférence (AWS Inferentia) de grands modèles de langage et de vision sur AWS.En passant par la plateforme Hugging Face, AWS veut donner plus de visibilité à ces outils et les rendre plus accessibles en prévision d’une explosion de la demande. Les clients peuvent utiliser les modèles Hugging Face sur AWS de trois façons : par le biais de SageMaker JumpStart, des conteneurs d'apprentissage profond (ou DLC pour Deep learning containers) AWS sur Hugging Face, ou des tutoriels pour déployer les modèles sur AWS Trainium (pour l'entraînement des modèles d'apprentissage automatique) ou AWS Inferentia (pour l'inférence des grands modèles linguistiques). Le DLC Hugging Face propose des transformateurs, des ensembles de données et des bibliothèques de tokenizers optimisés pour permettre aux développeurs d'affiner et de déployer des applications d'IA générative à l'échelle en quelques heures au lieu de quelques semaines, avec des modifications minimales du code. SageMaker JumpStart et les DLC Hugging Face sont disponibles dans toutes les régions où Amazon SageMaker est disponible, sans frais supplémentaires.