3 dernières années les attaques ont augmenté de 80 %. Les trois quarts des organisations interrogées déclarent ne pas disposer de l'expertise, des ressources et du budget nécessaires. Un constat inquiétant.

Signicat, acteur de l'identité numérique, a interrogé 1206 décideurs en matière de fraude dans le secteur financier en Belgique, en Allemagne, aux Pays-Bas, en Norvège, en Espagne, en Suède et au Royaume-Uni. Le tableau qui se dessine est plutôt sombre dans ce domaine. Il montre l’impact croissant de l’IA sur la nature et le volume des attaques. L’augmentation des tentatives de fraude au cours des trois dernières années atteint 80 %. En détail, trois menaces occupent le podium : la prise de contrôle de compte, l’usurpation d'identité et la fraude aux paiements par carte ainsi que les attaques via

des malwares et par phishing.

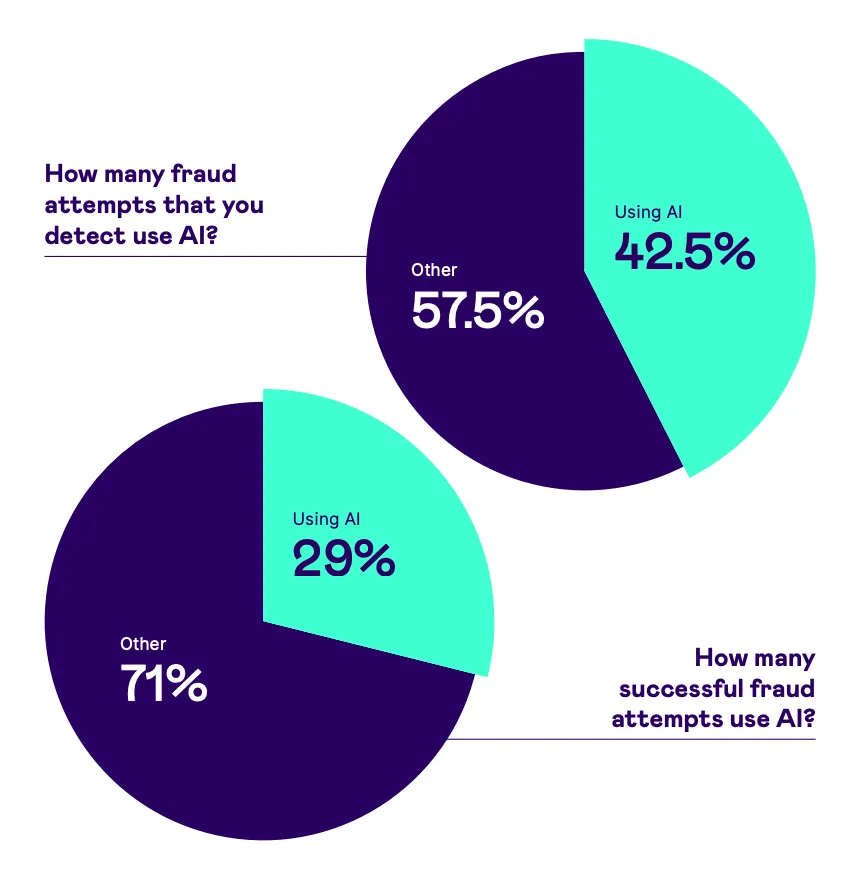

Dans les faits, les tentatives d'usurpation d'identité ont augmenté de 74 % au cours des trois dernières années. Quant aux tentatives de fraudes réussies grâce à l’IA, elles se montent à 29 % comme indique dans le graphique ci-dessous, ce qui n’est pas négligeable. L’ensemble des tentatives infructueuses qui font appel à l’IA se monte

à 42,5 % de l’ensemble.

Le secteur financier doit se mettre en ordre de marche pour combattre les nouveaux cyberisques

L’aspect le plus préoccupant du rapport de Signicat est le manque de préparation des institutions financières ne sont pas préparées à la fraude à l’identité liée à l’IA. Pour preuve, les trois quarts des entreprises interrogées déclarent ne pas disposer de l'expertise, des ressources et du budget nécessaires.L’IA peut être la solution, mais seuls 22 % des répondants disent avoir mis en œuvre des méthodes de défenses basées sur l'IA exposant ainsi l’entreprise à une vulnérabilité de niveau élevé. Côté « deepfake », ces fraudes qui utilisent les fichiers audio et vidéo, elle ne représentait que 0,1 % des tentatives de fraude il y a trois ans alors qu'aujourd'hui

elle en représente 6,5 %.

Plus de trois quarts des personnes interrogées sont conscientes des capacités des deepfakes à usurper l'identité des clients et du personnel mais aussi des limites humaines à les détecter. En contrepoint, environ trois quarts des répondants à l’étude pensent que les deepfakes ne seront jamais assez convaincants pour tromper les organisations financières. Une contradiction montrant qu’ils ne prennent pas ce type de menace au sérieux.

Un point d'inflexion des menaces liées à l'IA

Depuis 2021, les attaques par présentation (usurpation d’identité via le port de masque) et par injection (deepfakes et autres) ont sensiblement augmenté. Le rapport pointe aussi les deux problèmes majeurs des entreprises du secteur financier. D’une part, elles ont une médiocre connaissance des moyens de prévention des fraudes d'identité liées à l'IA et d’autre part, elles manquent des ressources nécessaires pour agir vite.Cependant, plus de trois quarts des organisations disposent d'équipes spécialisées dans ce domaine et mettent à niveau leurs méthodes et outils de prévention. À l’appui de ces moyens, elles espèrent disposer d'un budget plus important à cet effet. Un peu moins d'un quart du panel de l’étude a effectivement commencé à mettre en œuvre des mesures préventives et la plupart des autres prévoient de le faire au cours de l'année prochaine.

Faute de budget et des compétences, les petites organisations sont en retard, avec seulement 18 % d'entre elles qui ont déjà mis en place des mesures de réduction des risques. Globalement, la compréhension des capacités de l’IA, côté attaquants et côté entreprises, est encore limitée.