L’avènement des réseaux sociaux et de l’accès universel à Internet a créé de nouvelles opportunités pour les groupes, les individus et les institutions (gouvernements, partis, lobbys…) de propager de l’information aussi bien que de la désinformation. Parmi les outils de la désinformation, les deepfakes sont les plus dangereux, car ils sont difficiles à démasquer par l’utilisateur moyen. Ils peuvent sembler faire dire aux gens des choses qu’ils n’ont pas dites ou être à des endroits où ils n’étaient pas, et le fait qu’ils sont générés par l’IA qui peut continuer à apprendre rend inévitable qu’ils battent la technologie de détection conventionnelle.

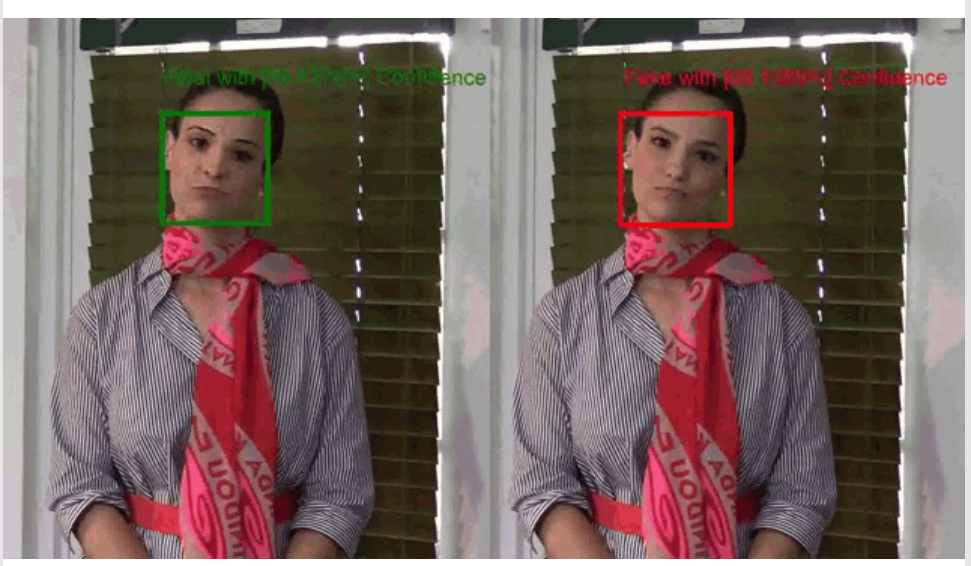

Dans le cadre de son programme Defending Democracy Program, Microsoft vient d’annoncer Microsoft Video Authenticator, un outil qui peut analyser une photo ou une vidéo pour fournir un pourcentage de chance, ou un score de confiance, révélant si le média a été artificiellement manipulé. Dans le cas d’une vidéo, il peut fournir ce pourcentage en temps réel sur chaque image pendant la lecture de la vidéo. Il fonctionne en détectant la limite de mélange de la photo et des éléments subtils de décoloration ou de niveaux de gris qui pourraient ne pas être détectables par l’œil humain. Et même si elle n’est pas fiable à 100 %, Microsoft estime « que ce genre de technologie peut être un outil utile pour aider les utilisateurs à identifier les faux », surtout que les élections américaines approchent et les campagnes de désinformation vont s’intensifier.

L’outil repose sur deux composants complémentaires

Video Authenticator repose sur deux composants destinés, pour l’un, à garantir l’authenticité et la provenance, et, pour le second, à détecter les faux. Le premier est un outil intégré à Microsoft Azure qui permet à un producteur de contenu d’ajouter des hachages et des certificats numériques à un contenu. Les hachages et les certificats sont ensuite intégrés au contenu sous forme de métadonnées, quel que soit le lieu où il se trouve en ligne. Le second est un lecteur — qui peut exister sous la forme d’une extension de navigateur ou sous d’autres formes — qui vérifie les certificats et les correspondances des hachages, permettant aux internautes de savoir avec un degré élevé de précision si le contenu est authentique et s’il n’a pas été modifié, et qui fournit des détails sur l’identité du producteur.

Cette technologie a été développée à l’origine par Microsoft Research en coordination avec l’équipe Responsible AI de Microsoft et le comité Microsoft AI, Ethics and Effects in Engineering and Research (AETHER), qui est un conseil consultatif chez Microsoft qui contribue à garantir que les nouvelles technologies sont développées et mises en œuvre de manière responsable. Video Authenticator a été créé à partir d’un ensemble de données publiques de Face Forensic++ et a été testé sur l’ensemble de données DeepFake Detection Challenge, deux modèles reconnus pour la formation et le test des technologies de détection de faux documents.