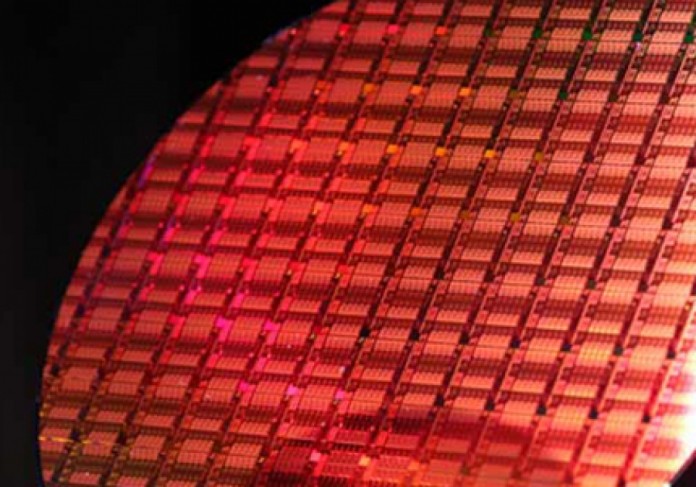

L'arrivée d'une nouvelle famille de processeurs pour serveurs est toujours un évènement, car elle est porteuse d'innovations multiples, tant sur le processeur que sur ses usages. L'annonce par Intel de la famille des processeurs Intel Xeon E7 v2 n'échappe pas à cette règle.

Basée sur l'architecture Ivy Bridge en 22nm (nanomètre ou milliardième de mètre), elle offre sur son modèle le plus performant 15 coeurs par processeur, doublés en 30 coeurs logiques par la technologie de tunneling dite Hyper Threading. Concrètement, un processeur Xeon E7 v2 placé sur une carte mère peut offrir l'équivalent de 30 serveurs... De quoi satisfaire les applications qui réclament de paralléliser fortement les traitements, comme la finance, les analytiques ou la virtualisation du poste de travail.

Les processeurs pour serveurs sont conçus pour fonctionner sur des cartes mères qui peuvent accueillir plusieurs d'entre eux en même temps, sur des sockets (éléments d'une carte-mère dans lesquels s'amboitent les processeurs). La nouvelle génération peut accueillir jusqu'à 32 sockets, soit jusqu'à 960 coeurs logiques en configuration optimale. C'est ce que l'on appelle une 'bête de guerre', ou un 'monstre technologique' selon les versions.

La mémoire est également importante sur un ordinateur. D'abord dans le processeur, c'est la mémoire cache qui accélère le traitement applicatif en mettant la donnée au plus proche du 'compute', du traitement ou calcul. Dans sa version haute, l'Intel Xeon E7 v2 dispose de 37,5 Mo de cache L3 partagée dynamiquement entre les coeurs. La mémoire externe, la RAM, va se parer de barrettes DDR3 et bientôt DDR4 de dernière génération, avec jusqu'à 1,5 To par socket, soit un triplement de la capacité par rapport à la version précédente.

Dernier aspect important apporté par cette nouvelle gamme de processeurs Intel pour serveurs, la connectivité se voit enrichie : un bus QuickPath Interconnect (QPI), 4 DMI et 40 PCIe (PCI Express) en version 3.0 supportant jusqu'à 8 Gbit/s. De quoi multiplier la bande passante, donc le volume de données qui peut transister dans le serveur.

Nous noterons que l'enveloppe énergétique de ces processeurs reste globalement la même, c'est à dire qu'ils consomment toujours autant, mais pour des performances et des capacités nettement améliorées.

Que faut-il retenir de cette annonce ?

Tout d'abord que malgré certaines limites technologiques annoncées, en particulier sur la capacité de miniaturisation des composants dans le silicium, la Loi de Moore reste de mise, le nombre de transistors embarqués sur un processeur continue de doubler tous les 18 mois. Face à la précédente génération, la famille des processeurs Intel Xeon E7 v2 affiche des performances doublées, une capacité de mémoire triplée, une bande passante sur les I/O (entrées/sorties) quadruplée, et un TCO (total cost of ownership ou coût total de possession) qui devrait être nettement inférieur à celui de ses concurrents, nous pensons en particulier aux processeurs Power d'IBM.

Ensuite que les fabricants de processeurs rapprochent leurs produits des grandes tendances technologiques du moment, qu'ils aident à supporter. Qu'il s'agisse d'embarquer plus de données au coeur du serveur, dans sa mémoire, pour accélérer les traitements, c'est le in-memory. Ou qu'il s'agisse d'augmenter la capacité de parallélisation de ces mêmes traitements, ce sont le big data et l'internet des objets.

Et au fur et à mesure de l'évolution de ses processeurs, Intel réduit le gap qui séparait la technologie x86 des technologies RISC, à savoir des serveurs issus des processeurs pour PC face aux processeurs qui équipent encore les gros systèmes informatiques... quand il ne les dépasse pas. Et cela pour un prix généralement nettement inférieur !