Au 2 février 2025, les fournisseurs et utilisateurs des systèmes d’intelligence artificielle, à savoir les SIA, opérant en Europe, devront se mettre en conformité avec l'AI ACT. Les sanctions seront applicables le 2 aout 2025 pour les IA à risques inacceptables avec un plafond d’amendes de 7 % du chiffre d’affaires annuel mondial de l’entreprise ou

de 35 millions d’euros. Pour préparer ses adhérents à ce texte européen qui concerne les organisations de travail de toutes tailles, le club informatique des grandes entreprises (CIGREF) a publié un guide de mise en œuvre de l’AI ACT qui se veut rassurant.

L’Europe, qui n’est jamais en retard pour édicter règles et directives, a adopté une approche par les risques. Au plus haut niveau figurent les systèmes de notation sociale tels qu’ils sont déjà en application en Chine. Aux deux plus faibles niveaux de risques figurent les chabots et les filtres anti-spam.

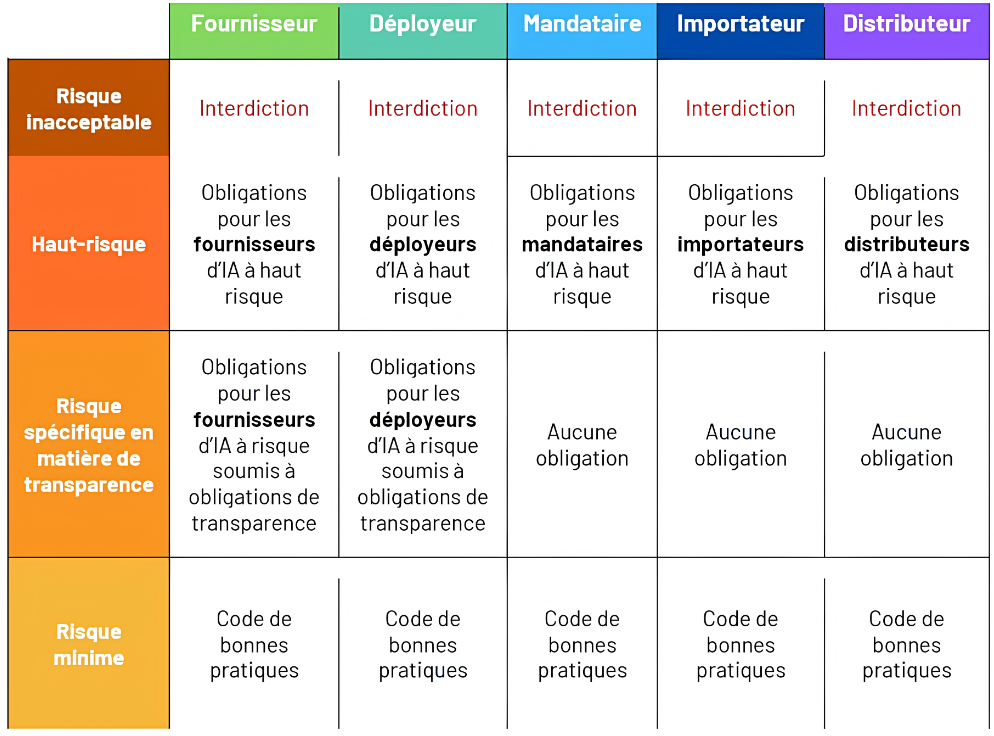

Le tableau ci-dessous résume toutes les obligations en fonction du rôle des acteurs concernés par l’AI ACT.

L’obligation de documentation et de transparence qui figure dans le texte vise les IA généraliste et génératives ainsi que les LLM, qu’ils soient open source ou non. Concrètement, les utilisateurs des IA devront publier un résumé sur les données d’entraînement des LLM et respecter, notamment, les réglementations relatives

au droit d’auteur.

De fortes oppositions à l’AI ACT

L’obligation de transparence et de publication des modèles d’entrainement des IA qui est la pierre angulaire de l’AI ACT semble difficile à appliquer totalement. En effet, imagine-t-on, par exemple, de demander à l’entreprise française Mistral AI de communiquer à l’autorité légale son algorithme et les détails de son modèle de langage ?De plus, le règlement européen devra cohabiter avec le RGPD, la directive sur le droit d'auteur dans le marché numérique et d’autres textes. Certains observateurs affirment que l’AI ACT est un frein à l'innovation et une contrainte forte sur les PME malgré certains allègements d’obligations, à l’heure où les défaillances d’entreprises augmentent. Olivier Laborde, directeur de l’innovation et de la transformation digitale de Natixis Assurances explique que l’Europe risque de prendre du retard par rapport aux États-Unis et à la Chine dans le domaine de l’IA suite à la mise en œuvre de l’AI ACT. L’application des règles en matière de transparence, de documentation et d’évaluation des systèmes d’intelligence artificielle pourrait retarder la mise en marché des produits et services.

Christian Klein directeur général de SAP, la plus grande entreprise européenne de logiciels, allègue aussi que la réglementation excessive de l'intelligence artificielle va creuser l'écart déjà important avec les États-Unis dans ce secteur.

Dans tous les cas, les entreprises devront prendre des mesures préventives telles que l'audit des systèmes d'IA existants, le renforcement des compétences des équipes chargées de la conformité et accroitre le budget pour que leur organisation soit prête dans

les délais prescrits.