L’enquête menée auprès d’un échantillon des équipes de sécurité et de développement en Amérique du Nord indique que les développeurs utilisent massivement l’IA générative (IAGen) en appui du processus de codage des applications. Ce type d’IA joue un rôle essentiel dans l'automatisation de tâches qui prenaient autrefois aux développeurs des heures, voire des jours. Mais l’étude montre aussi que cette large adoption induit de nouveaux risques, la quasi-totalité des répondants, soit 98 % du panel estimant que les équipes de sécurité ont besoin de mieux comprendre la façon dont l’IAGen

est utilisées par les développeurs.

De nouveaux risques tels l’AI jacking peut s’introduire dans la chaine de développement. Pour résumer, lors de cette attaque, les pirates identifient les modèles d'IA et LLM utilisés sur des plateformes de machine learning telles Hugging Face. Ils ciblent les dépendances significatives et analysent la chaine d’approvisionnement logicielle pour y déposer du code malveillant. Si la détection de ce code est trop tardive, les dégâts seront

d’autant plus importants.

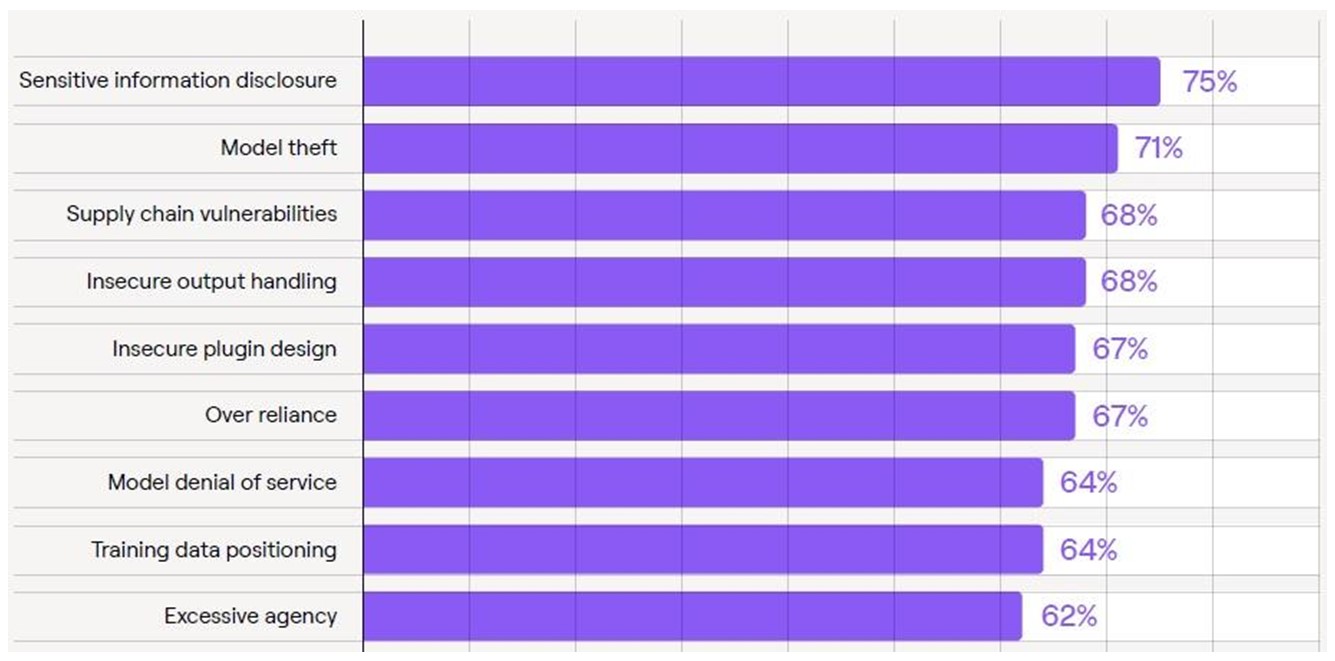

La graphique ci-dessous indique le niveau de risque pour les applications basées sur l’IAGen. Sur le podium figurent la divulgation de données sensibles, le vol de modèles et les vulnérabilités de la chaine logicielle.

Une vision commune des risques par les équipes de cybersécurité et les développeurs

Les responsables de la sécurité et les développeurs s’accordent sur les conséquences de l'utilisation de l’IAGen pour le développement des logiciels. Dans l'ensemble, 80 % d'entre eux affirment qu'il existe des failles de sécurité des solutions d’IAGen pour développer des logiciels. Cependant, les développeurs y sont légèrement plus favorables que les responsables de la sécurité (85 % contre 75 %).Dans l’étude de Legit Security, les assistants de code appuyés par l'IA tels que GitHub Copilot et TabNine, sont les outils les plus largement adoptés, avec 88 % des développeurs déclarant les utiliser au sein de leur organisation. Sous la pression de leur entreprise qui impose des délais de plus en plus serrés pour des projets plus complexes, le recours à l’IAGen est aujourd’hui fréquent. Ce type d’IA permet notamment d’automatiser la production de code, de tester et trouver les erreurs ou proposer des correctifs.

Près des trois quarts de l’échantillon des répondants (73 %) déclarent que les solutions basées sur l’IAGen sont utilisées pour les applications internes et plus de la moitié (56 %) disent qu'elles créent des applications externes à l’organisation.

Parmi les risques, 33 % des répondants citent la perte de confidentialité des données comme leur principale préoccupation lorsqu'elles utilisent des assistants de code, tandis que 11 % s'inquiètent surtout de devenir trop dépendants de ces outils.

Quel est le futur des outils d’aide au développement assistés par l’IA générative ?

Plus de la moitié des développeurs, soit 56 % d’entre eux, prévoient que l’IAGen s'occupera de la majeure partie du travail dans les années à venir, mais que les humains resteront toujours impliqués dans le processus. Une opinion qui tient du bon sens étant donné les imperfections des IA génératives et les risques induits. Près d’un répondant sur trois(29 %) pense que l’IAGen et les développeurs travailleront en collaboration. À noter cependant, 15 % des membres du panel de l’étude prévoient que la GenAI finira

par remplacer les développeurs.