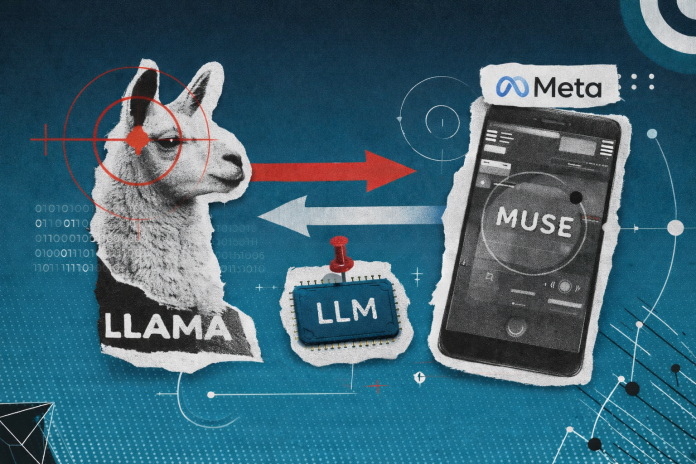

Le marché des LLM s'organise sur une ligne de fracture entre pure players, qui vendent de l’inférence en API, et les acteurs plateforme, qui intègrent l’IA dans des services qu’ils contrôlent. Meta, avec le lancement de Muse Spark, est un exemple parfait de stratégie de dédoublement : Llama assure à Meta une présence dans la couche fondationnelle ; Muse lui permet de verrouiller la valeur de l’expérience utilisateur sur ses plateformes.

Meta a annoncé Muse Spark, premier modèle de la famille Muse développée par Meta Superintelligence Labs, une entité distincte de FAIR et de l’équipe Llama créée pour piloter la ligne propriétaire du groupe. Cette annonce révèle une bifurcation stratégique avec, d’un côté Llama, socle ouvert destiné à l’écosystème ; de l’autre Muse, ligne propriétaire destinée à verrouiller l’expérience utilisateur sur les 3 milliards d’utilisateurs des plateformes de Meta. Ce dédoublement dit quelque chose de précis sur la recomposition en cours du marché des grands modèles de langage, et sur les erreurs que les acteurs établis ont commises quand ils ont tenté de jouer ce même jeu avec une génération technologique de retard.

Le marché de l’IA générative s’est structuré en moins de quatre ans autour d’une ligne de fracture claire : les pure players, OpenAI, Anthropic, Mistral, Cohere, qui vendent de l’inférence en API et construisent leur valeur sur la qualité du modèle et la profondeur de l’intégration ; et les acteurs plateforme, Google, Microsoft, Meta, Amazon, qui intègrent les capacités d’IA dans des produits et des surfaces existantes pour défendre ou étendre leur position. Cette distinction n’est pas seulement commerciale. Elle définit deux modèles économiques incompatibles, deux stratégies de monétisation opposées, et deux manières très différentes d’absorber le coût de l’entraînement et de l’inférence à grande échelle.

IBM Watson, un raté exemplaire

IBM est l’exemple le plus connu de ce que produit l’incapacité à naviguer cette bifurcation. Watson, lancé en 2011 avec l’éclat médiatique de sa victoire à Jeopardy !, reposait sur un moteur d’inférence symbolique, reposant sur des règles et des bases de connaissances formalisées, et un apprentissage supervisé sur corpus clos. Dans des domaines délimités et immuables, notamment pour répondre à des questions encyclopédiques, le système était impressionnant. IBM en a conclu qu’il était transposable à la médecine, au droit, à la finance.

Mais l’architecture de Watson ne permettait pas ces déclinaisons en systèmes experts. Watson est un modèle de type moteur d’inférence symbolique, il exige que le savoir soit formalisé et encodé manuellement par des experts pour chaque domaine. Un travail colossal que ni les ressources ni les délais disponibles ne permettaient de tenir. Ce n’était pas le modèle qui apprenait, c’était l’ingénieur qui empilait le savoir pour le modèle. Pendant que Watson consumait des milliards de dollars de ressources sur cette tâche de formalisation, le marché pivotait vers les transformers, qui apprenaient des représentations implicites du savoir directement à partir de texte brut, sans intervention humaine préalable.

La double pile de Meta : commoditiser le socle, verrouiller l’expérience

Llama et Muse composent la stratégie de couverture de Meta, qui répondent à deux risques distincts. Llama assure la présence de Meta au niveau de la couche fondationnelle, quelle que soit l’évolution du marché des modèles de fondation. Muse assure que Meta capture la valeur sur la couche d’expérience, là où ses concurrents ne peuvent pas le suivre. Les deux lignes sont complémentaires d’un point de vue stratégique. Llama est une stratégie de commoditisation. En rendant disponibles des modèles de fondation à poids ouverts, Meta exerce une pression continue sur les prix de l’inférence commercialisée par les pure players, construit un écosystème de développeurs liés à ses outils, et s’assure de ne jamais être exclu de la couche fondationnelle. C’est une capitalisation manifeste sur la leçon IBM : ne pas laisser un concurrent verrouiller le socle technologique pendant que l’on défend une architecture propriétaire.

Quant à Muse, il représente la stratégie de capture de valeur sur l’expérience des utilisateurs de ses plateformes. L’objectif déclaré est la superintelligence personnelle intégrée dans WhatsApp, Instagram, Facebook et les Ray-Ban Meta, ce qui revient à faire de Meta AI le point d’entrée de toutes les interactions des utilisateurs avec l’IA, sur des surfaces que personne d’autre ne contrôle. Ce dédoublement ressemble à ce qu’Apple a opéré avec ses puces, à savoir céder sur la question des standards ouverts pour mieux verrouiller la valeur sur ses propres produits, via une intégration verticale que les concurrents ne peuvent pas répliquer.

Cette stratégie place Meta dans une position structurellement distincte des pure players. OpenAI et Anthropic doivent convaincre des entreprises d’intégrer leurs API dans leurs propres produits, ce qui implique une dépendance de l’acheteur au vendeur, une pression sur les prix à mesure que les modèles se « commoditisent », et une exposition directe à la concurrence de Google et de Microsoft, qui intègrent leurs propres modèles dans leurs suites logicielles. Meta n’a pas besoin de convaincre. Il déploie sur des surfaces qu’il possède, auprès d’utilisateurs qui n’ont pas à choisir d’adopter le service.

Le risque : un fiasco réglementaire plutôt que technologique

La protection structurelle que Meta possède et qu’IBM n’avait pas, c’est le volume et la profondeur de ses données comportementales. Watson n’avait aucun équivalent de cet acabit. IBM vendait de la capacité de traitement à des clients qui possédaient leurs propres données et pouvaient changer de fournisseur. La valeur de Muse repose sur le principe inverse. Plus le modèle s’intègre aux interactions quotidiennes des utilisateurs, plus les données enrichissent l’inférence personnalisée, plus la proposition de valeur se distingue de ce que les pure players peuvent proposer à partir de données génériques.

Mais cette force est aussi une exposition directe, car la promesse de Muse repose sur la profondeur des données personnelles, ce qui entre frontalement en collision avec le RGPD et l’AI Act européens. Meta cumule un historique de contentieux lourds avec les autorités de protection des données en Europe et une procédure au titre de l’AI Act sur ses pratiques d’entraînement. Si les autorités européennes obtiennent des restrictions sur l’utilisation des données comportementales à des fins d’inférence personnalisée, la proposition de valeur de Muse s’effondre en grande partie sur un marché de 450 millions de personnes.

Ce serait un Watson à l’envers. L’architecture serait techniquement valide mais juridiquement inutilisable sur son deuxième marché mondial. La recomposition du marché des grands modèles se joue autant sur la capacité des acteurs à aligner leur modèle économique avec les cadres réglementaires que sur la qualité de l’inférence ou la profondeur de l’intégration. C’est la variable que ni IBM avec Watson, ni Meta avec Muse, n’ont encore résolue de façon définitive.