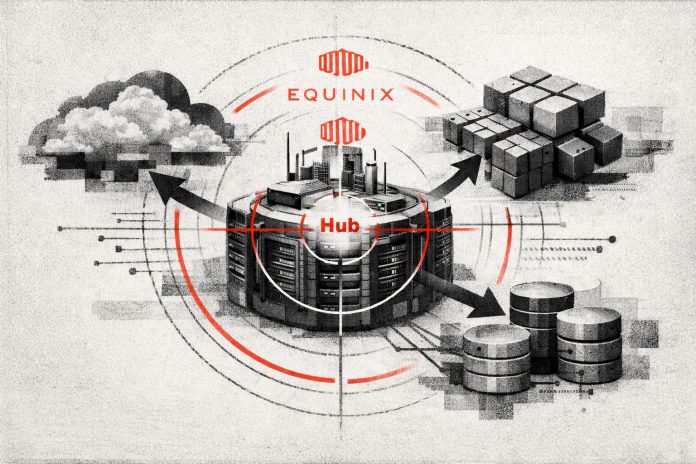

Equinix lance le Distributed AI Hub, un cadre d’infrastructure neutre conçu pour connecter, sécuriser et simplifier les écosystèmes d’IA distribués des entreprises. Disponible dans les 280 centres de données haute performance d’Equinix à travers le monde, le Hub s’appuie sur Equinix Fabric Intelligence et intègre en première instance la solution de sécurité Prisma AIRS de Palo Alto Networks pour protéger en temps réel les interactions entre agents IA, modèles et sources de données externes.

Le déploiement de l’IA agentique en entreprise bute sur une contradiction structurelle : les charges de travail d’inférence et les données d’entraînement sont réparties entre clouds publics, centres de données privés, environnements edge et néo-clouds spécialisés GPU, chacun avec ses propres contraintes de performance et de souveraineté. À mesure que les systèmes d’IA cessent d’être des outils ponctuels pour devenir des agents autonomes enchaînant des appels vers des modèles, des bases de données et des services tiers, la complexité de gouvernance et d’interconnexion croît de manière non linéaire. Mary Johnston Turner, research vice president, Digital Infrastructure Strategies chez IDC, résume l’enjeu ainsi : « Les entreprises se précipitent pour déployer une IA agentique mais constatent que leur infrastructure existante n’a jamais été conçue pour répondre à la complexité d’une intelligence distribuée. » IDC projette que 80 % des entreprises déploieront une infrastructure edge distribuée d’ici 2027 pour améliorer la latence et la réactivité de leurs applications d’IA.

Face à cette fragmentation, Equinix entend occuper une position de tiers neutre entre les hyperscalers, les fournisseurs de modèles et les entreprises clientes. L’intention déclarée est de construire l’un des écosystèmes d’IA les plus vastes et les plus ouverts du marché, en s’appuyant sur son réseau mondial de 280 centres de données déjà utilisés comme points d’interconnexion par une large base de clients. Le Distributed AI Hub est la traduction opérationnelle de ce positionnement : un cadre unifié qui permet aux entreprises de composer leur propre architecture d’IA à partir des meilleurs fournisseurs disponibles, sans dépendance à l’écosystème fermé d’un fournisseur unique.

Un point de convergence neutre entre clouds, données et IA

Le Distributed AI Hub se positionne comme un environnement neutre vis-à-vis des fournisseurs, contrairement aux plateformes d’IA des hyperscalers qui privilégient leurs propres services. Il permet aux entreprises de connecter modèles, données, capacités de calcul et partenaires d’écosystème dans un cadre unifié, sans contraindre les organisations à reconstruire leur architecture ni à déplacer leurs données vers d’autres environnements. La connectivité est assurée via des liens privés à faible latence au sein du réseau Equinix Fabric Intelligence.

Jon Lin, Chief Business Officer chez Equinix, formule la proposition de valeur centrale : « L’IA n’est pas centralisée mais une infrastructure adaptée peut lui permettre de fonctionner comme si elle l’était. Equinix est le terrain neutre où convergent les infrastructures d’IA, de cloud et de réseau. L’inférence peut ainsi être exécutée au plus près des données et des utilisateurs, sans la complexité opérationnelle qu’imposent les architectures distribuées. » Pour le DSI, l’enjeu opérationnel est direct : exécuter les charges de travail d’IA là où elles offrent les meilleures performances, avec une gouvernance et un contrôle cohérents sur l’ensemble des environnements.

Palo Alto Networks pour la sécurité des agents IA

La première intégration du Hub est réalisée avec Palo Alto Networks, dont la solution Prisma AIRS assure une protection en temps réel des interactions entre agents IA, modèles et outils externes. Cette couche de sécurité couvre un périmètre que les architectures traditionnelles ne traitent pas : les flux entre agents autonomes, les appels vers des sources de données externes et les interactions avec des frameworks d’IA tiers. Prisma AIRS sera également disponible sur Equinix Network Edge, permettant une gestion centralisée des politiques de sécurité au plus près des utilisateurs, des clouds et des applications critiques.

Pour le RSSI, cette intégration répond à une problématique émergente : dans un environnement d’IA agentique, la surface d’attaque ne se limite plus aux terminaux et aux API — elle englobe les chaînes d’interactions entre modèles, agents et données, dont la traçabilité et le contrôle d’accès restent souvent insuffisants dans les déploiements actuels. Lloyd Taylor, CTO et CISO chez Alembic, précise : « L’enjeu ne se limite pas à la puissance de calcul ou aux données. Il s’agit de maîtriser où se trouvent les données et où s’exécute le calcul. »

Une architecture pensée pour la souveraineté et la performance

La disponibilité du Distributed AI Hub dans 280 centres de données Equinix à travers le monde adresse directement les contraintes de résidence des données et de latence qui freinent les déploiements d’IA à grande échelle. Pour les organisations soumises au RGPD ou à des exigences sectorielles de localisation des données, la possibilité d’exécuter l’inférence au plus près des données sans transit vers des environnements extérieurs constitue un argument de conformité tangible.

Pour les directions IT confrontées à des architectures multi-cloud complexes, le Hub réduit la charge d’intégration en centralisant la découverte et la connexion aux fournisseurs d’infrastructure d’IA, modèles, clouds GPU, plateformes de données, services réseau et frameworks, via un point d’accès unique.

Equinix présentera le Distributed AI Hub en avant-première de la conférence Nvidia GTC.