OpenAI vient d’annoncer une levée de fonds de 110 milliards de dollars à une valorisation de 730 milliards, portée par Amazon (50 Md$), SoftBank (30 Md$) et Nvidia (30 Md$). Cette opération, la plus importante de l'histoire du secteur technologique, marque le passage de l'IA frontier d'un statut de recherche à celui d'infrastructure économique mondiale.

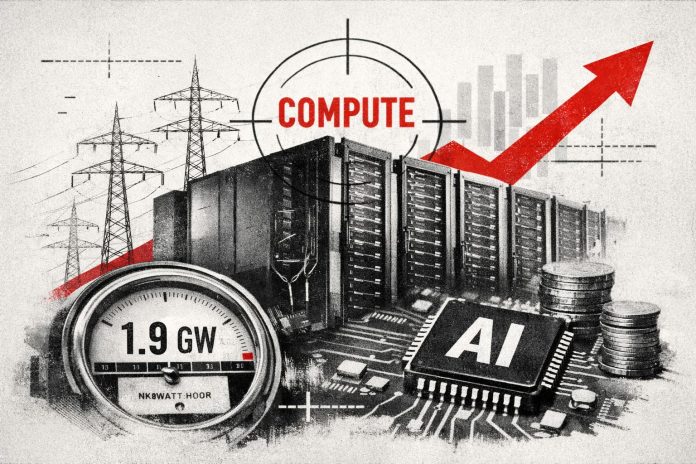

Tandis que le taux d'implémentation complète de l’IA en entreprise a bondi de 11 % à 42 % entre 2024 et 2025 selon Salesforce, l'annonce d’OpenAI survient dans une dynamique de marché déjà sous tension. L’éditeur de ChatGPT revendique 900 millions d'utilisateurs hebdomadaires actifs et 50 millions d'abonnés payants — des volumes qui ont mécaniquement tiré l'ARR de 2 milliards de dollars en 2023 à 20 milliards en 2025, au rythme exact de la croissance de capacités de computation déployées : 0,2 GW en 2023, 0,6 GW en 2024, 1,9 GW en 2025. C'est cette corrélation — et non la seule taille du tour de table — qui constitue le signal structurel pour les décideurs IT, car la puissance de calcul disponible est devenue la variable déterminante de la compétitivité.

La structure du tour de table révèle une logique d'intégration verticale. Amazon apporte 50 milliards de dollars et consolide un partenariat sur l'infrastructure cloud et les cas d'usage en entreprise. Nvidia engage 30 milliards et garantit à OpenAI l'accès prioritaire à la prochaine génération de puces d'inférence. SoftBank engage une mise identique dans une optique de déploiement à l'échelle mondiale. Ces trois axes — compute, distribution cloud, capital de croissance — correspondent exactement aux trois piliers identifiés par OpenAI pour répondre à la demande : capacité de calcul, canaux de distribution, réserves financières.

La corrélation entre compute et valeur client se confirme

La corrélation entre compute et valeur client se vérifie dans les chiffres fournis. OpenAI indique que son compute a été multiplié par 9,5 entre 2023 et 2025, et que le chiffre d'affaires a suivi la même courbe, multiplié par 10 sur la même période. « Nous sommes convaincus que davantage de compute, dans ces périodes, aurait conduit à une adoption client plus rapide et à une monétisation accélérée », précise Sam Altman, PDG d'OpenAI. Ce lien de causalité oriente les décisions d'investissement des hyperscalers partenaires et conditionne la disponibilité et les coûts d'inférence pour les entreprises clientes dans les 24 à 36 mois à venir.

L'impact sur les coûts d'usage de cette corrélation entre compute et valeur client est d’ors et déjà mesurable. Le coût d'inférence pour des systèmes de niveau GPT-3.5 a chuté de 280 fois entre novembre 2022 et octobre 2024 selon Stanford HAI. Ce facteur de réduction rend économiquement viables des cas d'usage qui ne l'étaient pas à l'échelle — traitement documentaire massif, assistance métier en temps réel, orchestration d'agents autonomes sur des workflows complexes. Pour les entreprises, cette trajectoire de coût constitue le socle sur lequel construire un cas d’usage sans risque de dégradation de la rentabilité par inflation des charges d'inférence.

La Frontier Alliance mise à contribution

Simultanément à l'annonce de financement, OpenAI a lancé l'OpenAI Frontier Alliance avec BCG, McKinsey, Accenture et Capgemini. L'objectif est d'accélérer le passage des projets exploratoires vers des déploiements en production, ce qui identifie précisément le goulet d'étranglement actuel du marché : non plus la disponibilité des modèles, mais la capacité organisationnelle à les opérationnaliser. Pour les grandes DSI, cela se traduit par la disponibilité de méthodologies certifiées par des intégrateurs ayant un accès direct aux équipes techniques d'OpenAI, réduisant le risque d'implémentation sur des projets critiques.

Sur le plan produit, Codex illustre la vitesse d'adoption dans le segment développeur. OpenAI indique que le nombre d'utilisateurs hebdomadaires actifs de Codex a plus que triplé depuis le début de l'année 2026 pour atteindre 1,6 million. Ce chiffre signale que la délégation de tâches de développement à des agents IA dépasse le stade expérimental dans les équipes d’ingénierie. Les données internes d'OpenAI sur la population entreprise confirment que 87 % des collaborateurs IT déclarent une résolution plus rapide des incidents depuis l'intégration de l'IA, et que les utilisateurs avancés économisent plus de dix heures par semaine.

Quant au déploiement de l'IA dans les workflows des entreprises, il subit désormais une bifurcation des usages. OpenAI identifie un écart croissant entre les « frontier firms », entreprises ayant intégré l'IA en profondeur, qui génèrent deux fois plus d'interactions par siège et mobilisent l'IA sur un spectre fonctionnel élargi, et les organisations encore en phase de test. Cette segmentation est cohérente avec le constat de Salesforce : le saut de 11 % à 42 % de taux d'implémentations complètes ne reflète pas une progression homogène, mais une accélération concentrée chez les adopteurs qui capitalisent sur un avantage concurrentiel cumulatif.

Contrainte énergétique et stratégie d'infrastructure

L’avènement de l'IA frontier génère une pression énergétique jamais exercée sur les infrastructure. Les centres de données américains ont consommé 183 TWh d'électricité en 2024, soit 4 % de la consommation nationale, avec une projection de croissance de 133 % d'ici 2030 selon l'IEA. Cette trajectoire transforme la disponibilité énergétique en variable de localisation pour les infrastructures IA — un paramètre qui entre directement dans les décisions de choix de région cloud, de design d'architecture multicloud et de négociation contractuelle avec les hyperscalers.

OpenAI a répondu à cette contrainte par une diversification de son portefeuille de compute. La société est passée d'un fournisseur unique en 2022 à un écosystème multi-fournisseurs en 2025, ce qui lui permet de disposer de centres premium pour l'entraînement et d’infrastructure optimisée pour l'inférence à volume élevé. Le résultat est une réduction de la latence, une amélioration du débit, et des coûts d'inférence ramenés à l'ordre du centime par million de tokens, seuil en dessous duquel l'intégration dans des workflows métier quotidiens devient viable sans impact significatif sur le budget de l’IT.

Pour les RSSI européens, la concentration capitalistique autour d'un nombre restreint de fournisseurs d'infrastructure IA soulève des questions de souveraineté des données et de concentration du risque systémique. Un accord entre OpenAI et Amazon implique que les traitements sur ChatGPT Enterprise ou l'API OpenAI transitent par une infrastructure dont l'architecture de sécurité est co-définie par deux entités américaines ayant chacune leurs propres obligations réglementaires. Ce point conditionne directement la conformité des usages pour les organisations soumises au RGPD ou opérant dans des secteurs régulés.

Les agents autonomes, la prochaine vague d'intégration IT

Au-delà des métriques d'adoption actuelles, la trajectoire produit d'OpenAI oriente les architectures IT vers une couche agentique. La société décrit explicitement la prochaine phase comme des agents et des automatisations de workflows qui fonctionnent en continu, maintiennent un contexte dans le temps et agissent à travers les outils. Pour les architectes, cela implique une refonte des modèles d'intégration : non plus des appels API ponctuels, mais des agents persistants dotés d'accès délégués à des systèmes métier, capables d'exécuter des séquences de tâches multi-étapes sur des horizons temporels étendus.

Les indicateurs d'usage confirment que cette transition est en cours dans les organisations les plus avancées. Les « frontier workers » — 95e percentile en termes d'intensité d'utilisation — génèrent six fois plus d'interactions que l'utilisateur médian et mobilisent l'IA sur un spectre de tâches nettement plus large. Ce profil d'usage préfigure le modèle de travail augmenté à l'échelle de l'organisation : non pas un outil d'assistance ponctuelle, mais un substrat d'exécution intégré aux processus métier. OpenAI publie une fonctionnalité ou une capacité nouvelle environ tous les trois jours ; la contrainte principale pour les organisations n'est plus la maturité des modèles, mais la capacité à absorber ce rythme d'innovation dans des processus de gouvernance et de déploiement IT.

Le financement annoncé ne signifie pas seulement qu'OpenAI dispose des ressources pour tenir sa feuille de route technique. Il signifie que les trois partenaires — Amazon, Nvidia, SoftBank — ont aligné leurs intérêts sur l'accélération de la diffusion de l'IA frontier dans l'économie mondiale. Pour les décideurs IT, cela se traduit par une convergence accélérée des offres cloud, hardware et applicatives autour de standards communs, une réduction prévisible des coûts d'inférence et une pression concurrentielle croissante sur les organisations qui n'ont pas encore engagé leur trajectoire de déploiement à l'échelle.